Tendencias Digitales, Latam – La IA en el Gobierno: Un Caso de Advertencia

La utilización de herramientas de inteligencia artificial (IA) en funciones gubernamentales críticas siempre enciende las alarmas, especialmente cuando estas tecnologías demuestran fallos que comprometen servicios esenciales. Una investigación reciente ha puesto de manifiesto cómo una herramienta de IA implementada por el extinto Departamento de Eficiencia Gubernamental (DOGE), bajo la dirección de elon Musk, clasificó erróneamente contratos vitales del Departamento de Asuntos de Veteranos (VA) como susceptibles de cancelación, con graves repercusiones para la atención sanitaria de los veteranos. Este incidente no solo subraya, sino que enfatiza la necesidad imperante de una supervisión rigurosa y una validación exhaustiva de los sistemas de IA antes de su despliegue en ámbitos que impactan directamente el bienestar ciudadano.

La IA del DOGE: Un Precedente Problemático… y con Factura en la Gestión Contractual

El origen de esta controversia se remonta a la implementación de una herramienta de IA diseñada para identificar contratos que, según la terminología del DOGE, eran «munchable» -es decir, ¡listos para ser ‘devorados’ o cancelados!- con el objetivo de optimizar el gasto público. esta iniciativa, desarrollada por Sahil Lavingia, un programador sin experiencia previa en el complejo sector de la atención sanitaria, analizó más de 2.000 contratos del VA. Sin embargo, su funcionalidad dejó mucho que desear en cuanto a precisión, llevando a una serie de decisiones erróneas que afectaron directamente a los servicios médicos destinados a los veteranos.

Algoritmos Fallidos: Las Cancelaciones con Costo humano

La herramienta de IA demostró fallos críticos en su capacidad para interpretar y valorar la documentación contractual.Un ejemplo que salta a la vista de estas imprecisiones se manifestó cuando el algoritmo determinó que ciertos contratos tenían un valor de 34 millones de dólares,¡cuando en realidad su importe apenas alcanzaba los 35.000 dólares! Esta disparidad, un claro bug en la lectura defectuosa de los documentos, condujo a la identificación errónea de numerosos acuerdos como onerosos y prescindibles. A raíz de estas recomendaciones, el VA procedió a la cancelación de cerca de 600 contratos.

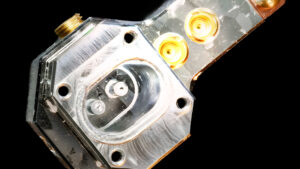

Lo más preocupante es que, entre los acuerdos rescindidos, se encontraban servicios de mantenimiento para un dispositivo de secuenciación genética y análisis de muestras de sangre fundamentales para la investigación. La interrupción de tales servicios, cruciales para diagnósticos avanzados y el progreso de la medicina, representa un riesgo significativo, poniendo en jaque la calidad y la continuidad de la atención que reciben nuestros veteranos. La falta de un firewall humano, es decir, un proceso de verificación manual robusto, permitió que las deficiencias del algoritmo se tradujeran en decisiones administrativas con consecuencias tangibles y, tristemente, humanas.

Cuando los Expertos Alzan la Voz: Los Riesgos de la IA no Validada

Frente a la magnitud de los fallos, las voces expertas no tardaron en alzarse, expresando su profunda preocupación. Cary Coglianese, profesor de la Universidad de Pensilvania, ha sido contundente: estas herramientas de IA generativa, para tareas de tal envergadura, son simplemente inmaduras. «No creo que los LLM (Grandes Modelos de Lenguaje) listos para usar tengan un alto grado de fiabilidad para algo tan complejo y profundo como esto», afirmó Coglianese. Su declaración es un wake-up call: la cautela es más que necesaria al aplicar tecnologías emergentes en contextos donde la precisión no es solo un requisito, ¡es una obligación innegociable!

Hasta el propio arquitecto de la herramienta, Sahil Lavingia, tuvo que reconocer las limitaciones y, sí, los posibles errores de su diseño. «Creo que se cometieron errores… Estoy seguro de que se cometieron errores.Siempre se cometen errores», declaró Lavingia, y añadió una analogía ilustrativa que resuena con la cultura digital: «Nunca recomendaría a nadie que ejecute mi código y haga lo que dice. Es como ese episodio de ‘The Office’ donde Steve Carell conduce hasta el lago porque Google Maps dice que conduzca hasta el lago.No conduzca hasta el lago.» Esta cruda admisión no hace más que recalcar la imperiosa necesidad de un ojo crítico y una validación humana en la toma de decisiones críticas, más allá de la mera automatización.

El Congreso Entra en Juego: Transparencia Pendiente

Era cuestión de tiempo: la situación ha captado la atención del poder legislativo. Los Demócratas del Congreso han estado ejerciendo una fuerte presión sobre los líderes del VA para obtener información detallada sobre las cancelaciones de contratos y sus justificaciones. Esta fiscalización busca esclarecer el proceso de toma de decisiones y determinar el alcance real del impacto en la atención a los veteranos, así como establecer responsabilidades. La transparencia en la aplicación de la IA en la administración pública no es un lujo, ¡es un pilar essential para garantizar la rendición de cuentas y proteger a los ciudadanos!

Este episodio en el Departamento de Asuntos de Veteranos queda como una advertencia rotunda sobre los peligros inherentes a la implementación de IA sin una debida diligencia. La promesa de la eficiencia tecnológica jamás debe menoscabar la calidad de los servicios ni la seguridad de los ciudadanos, especialmente en sectores tan sensibles como la salud y la seguridad nacional. La lección es inequívoca y resuena fuerte: la IA, si bien es una herramienta poderosísima, requiere una supervisión humana experta y un marco regulatorio robusto para evitar consecuencias no deseadas, ¡y vaya si este caso lo demuestra!

Para no perderte ni un solo bit de lo último en tecnología y tendencias digitales, ¡sigue a Tendencias digitales!